✨ AI Kontextualisierung

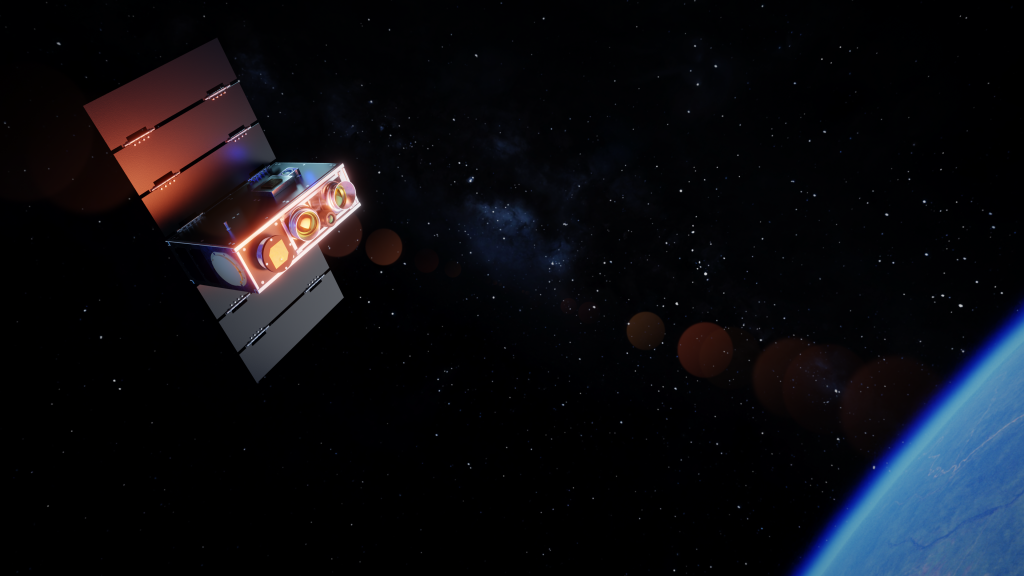

„Satellitengestützte Thermalsensorik“ ist der Fachausdruck dafür. Einfach erklärt: Mit der Nanosatelliten-Technologie des Münchner Startups OroraTech können Temperaturen auf der Erdoberfläche vom Weltall aus gemessen und erkannt werden. Das wird unter anderem zur Bekämpfung von Waldbränden genutzt, wie brutkasten bereits mehrfach berichtete. Unter anderem ist die Europäische Raumfahrtagentur ESA Kunde des Startups – brutkasten berichtete vergangenes Jahr über die Erteilung eines Millionenauftrags.

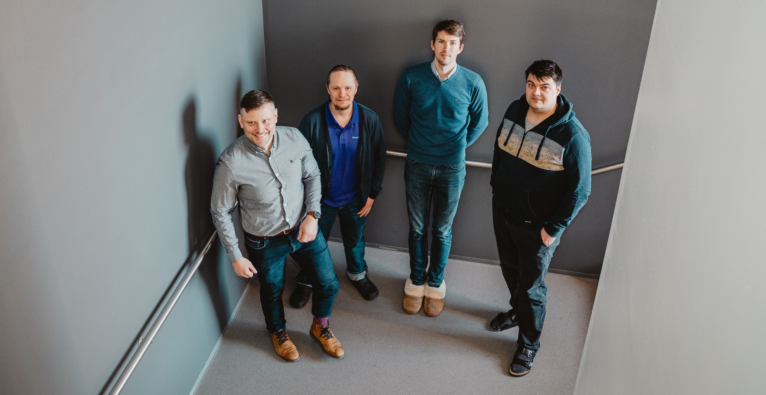

Schon 2022 schloss OroraTech seine Series A-Finanzierungsrunde über 15 Millionen Euro ab. Damals stand mit dem Kärntner Thomas Grübler ein Österreicher als CEO an der Spitze des Startups. 2023 gab der Mitgründer den Chefposten dann ab und wurde Chief Strategy Officer, wie brutkasten berichtete.

Series B-Runde für OroraTech mit Korys, Bayern Kapital und European Circular Bioeconomy Fund

Nun verkündete OroraTech den Abschluss seiner Series B-Finanzierungsrunde über 25 Millionen Euro. Den Lead dabei übernahm die belgische Beteiligungsgesellschaft Korys. Zudem investierten Bestandsinvestor Bayern Kapital des Freistaats Bayern mit dem „Wachstumsfonds Bayern 2“, der European Circular Bioeconomy Fund sowie weitere Bestandsinvestoren. „Die Mittel aus der aktuellen Finanzierungsrunde sollen weitere Satelliten-Starts, die Marktexpansion und die Weiterentwicklung der OroraTech-Technologien unterstützen, insbesondere in den Bereichen betriebliche Effizienz und prädiktive KI“, heißt es vom Unternehmen.

OroraTech hat aktuell zwei eigene funktionsfähige Satelliten im Weltall. Diese haben etwa die Größe einer Schuhschachtel. Man plane im nächsten Jahr, neun weitere Satelliten in den Orbit zu starten, so das Startup. Darüber hinaus aggregiert das Unternehmen 25 weitere öffentliche Satelliten und sonstige Datenquellen, die die Identifizierung und Vorhersagegenauigkeit von Waldbränden unterstützen. Mit der „Wildfire Intelligence Solution“ werden aktuell weltweit mehr als 347 Millionen Hektar Wald auf sechs Kontinenten geschützt.

OroraTech plant zudem weitere Anwendungsmöglichkeiten für seine Technologie, „beispielsweise zur Überwachung von umweltschädlichen Gasfackeln und Abgasfahnen, für die Kartierung von Wärmeinseln in Städten zur besseren Vorhersage von Hitzewellen sowie für umfangreiche landwirtschaftliche Analysen für die Agrarindustrie“, heißt es vom Unternehmen.