✨ AI Kontextualisierung

Der AI Act ist seit heute Mitternacht in Kraft. Er betrifft Startups, die KI-Anwendungen entwickeln und auch solche, die sie verwenden. Die EU will damit KI regulieren und sicherstellen, dass die Technologie nicht zur Gefahr für Grund- und Menschenrechte wird.

Die Vorarbeiten zur KI-Verordnung sind bereits seit mehr als fünf Jahren im Gange. Darin verwoben sind auch Vorschläge der Wiener Rechtswissenschafterin und Expertin für Digitalisierung und Innovation im Recht Christiane Wendehorst. “Ganz viel von dem, was wir jetzt auch in der KI-Verordnung sehen, wurde im Prinzip 2018 entwickelt”, erzählt sie im brutkasten-Talk.

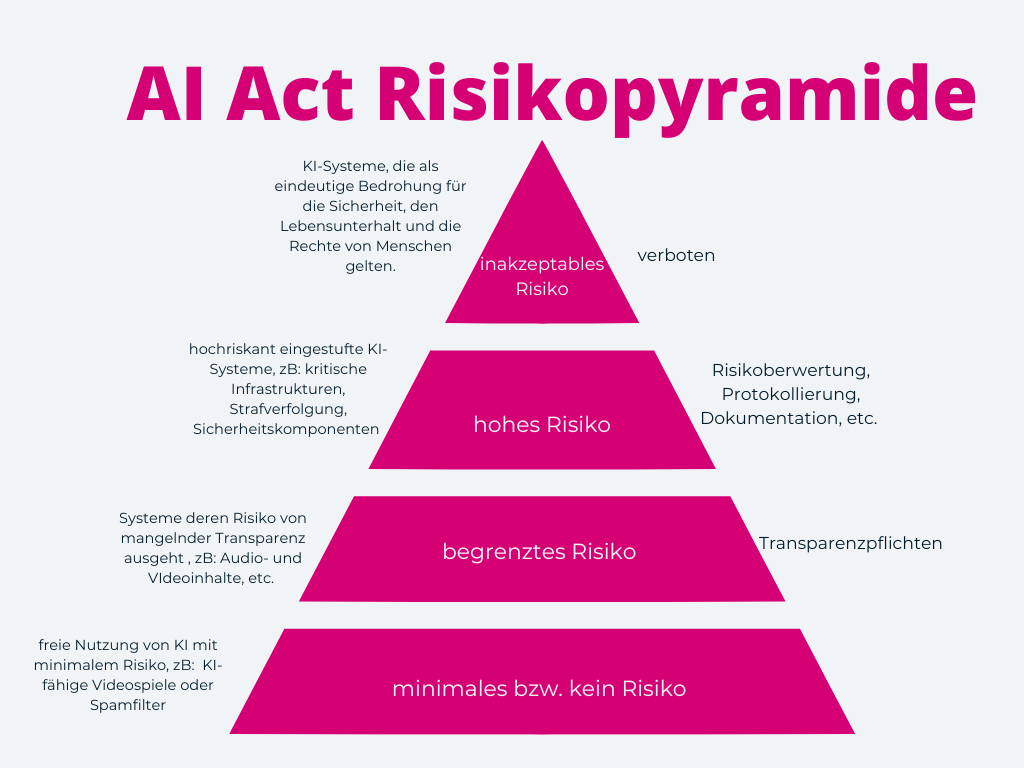

AI Act: Risikopyramide als Herzstück

Die Struktur der KI-Verordnung ist jene eines Produktsicherheitsgesetzes. Das heißt, sie klassifiziert KI-Anwendungen nach ihrem Risikopotenzial und definiert, wie diese Gefahren von KI-Herstellern als auch KI-Usern einzuschätzen und einzudämmen sind. Als „Herzstück“ der KI-Verordnung gilt die Risikopyramide. Die für KI-Systeme geltenden Regeln sind gestaffelt nach deren Risiko und dabei folgen sie dem Prinzip: Je größer das Risiko, desto größer die Pflichten.

Für Startups bedeutet diese Risikopyramide zunächst, dass sie selbst Einschätzungen ihrer KI-Anwendungen vornehmen müssen. Der Gesetzgeber hat eine Einteilung für KI-Systeme erstellt und sogenannte Hochrisiko-KI-Systeme definiert, die in Artikel 6 der KI-Verordnung sowie im Anhang III festgelegt sind. Startups, die ein KI-System entwickeln oder verwenden, müssen nun also überprüfen, ob ihr System unter diese Risikostufe fällt. Wenn dem so ist, müssen sie die genauen Anforderungen in dieser Risikoklasse beachten.

ACHTUNG: Der Anhang III zu Hochrisiko-KI-Systemen kann von der Kommission laufend ergänzt werden, daher sollten Startups diesen Anhang im Blick behalten.

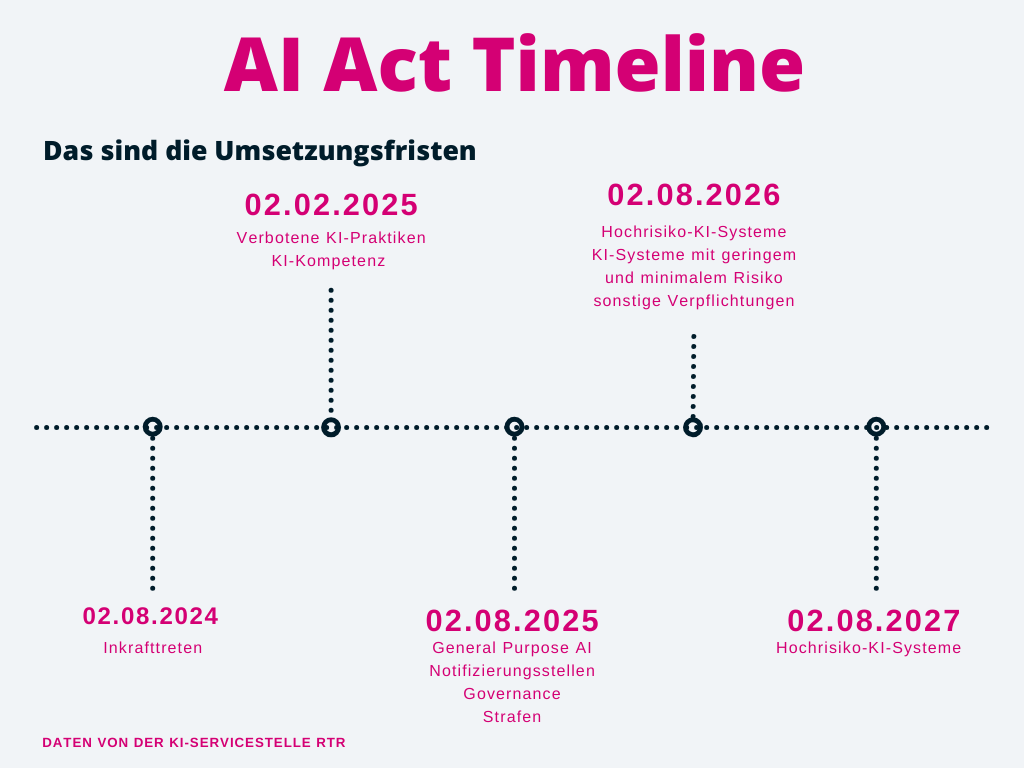

Fristen: keine Panik, aber auch kein Müßiggang

Für alle, die ob des Inkrafttretens nervös werden, gilt: Keine Panik. Die KI-Verordnung geht mit großzügigen Übergangsfristen einher. Wer sich mit der KI-Verordnung beschäftigen sollte, sind Startups, die KI-Anwendungen entwickeln oder diese für ihr Unternehmen verwenden. Für sie gilt es sich in der nächsten Zeit anzuschauen, in welche Risikoklasse die KI eingestuft wird. Die Rechtswissenschafterin rät Startups, diese Risikoeinschätzung bald vorzunehmen. „Nicht kalkulieren: Ich lasse mir jetzt erst einmal Zeit und es wird schon nicht so arg sein und dann warte ich bis zum letzten Tag“, so Wendehorst.

Nach dem Inkrafttreten gilt erst einmal eine Übergangsfrist von sechs Monaten. Viele der Vorschriften betreffen Startups, wenn sie Hochrisiko-KI-Systeme verwenden. Die Vorschriften von Kapitel 1 und 2 werden nach Ablauf einer Frist von sechs Monaten anwendbar. Erst in einem Jahr sind dann General Purpose AI Systeme dran. Die meisten Vorschriften werden erst in 2 Jahren anwendbar und manche sogar erst nach 36 Monaten.

ACHTUNG: Umsetzungsschritte bedürfen in manchen Fällen Zeit und Vorbereitung. Es gilt daher bereits in der Übergangsfrist zu schauen, welche Systeme des Startups in eine Risikoklasse fallen könnten.

Das Spannungsfeld der KI-Verordnung

„Der risikobasierter Ansatz bedeutet, dass nicht alle KI-Systeme oder alle algorithmischen Systeme, die wir haben, gleichermaßen reguliert werden. Weil damit würden wir auch die Innovation hemmen, damit würden wir die KI-Entwicklung in Europa hemmen“, erklärt Wendehorst die Vorteile der Risikopyramide.

Die KI-Verordnung reguliert in einem Bereich, der sich im Spannungsfeld zwischen Sicherheitsbedürfnis und Innovationspotenzial befindet. Genau deshalb wäre der risikobasierte Ansatz angebracht, weil er Verhältnismäßigkeit in den Vordergrund stelle, meint die Rechtswissenschafterin. „Es muss eben strikt nach dem Verhältnismäßigkeitsprinzip vorgegangen werden“, sagt sie. Im brutkasten-Talk beschreibt sie das Potenzial der Verordnung sowohl Risiko von KI einzudämmen, als auch Innovation zu erlauben.

Startup-Innovationen waren Streitpunkt bis zum Schluss

Den Gesetzesentwurf hat die Kommission im April 2021 vorgelegt. Dann kam die Veröffentlichung von ChatGPT und daraufhin die weltweite Verbreitung von Künstlicher Intelligenz im Hausgebrauch. Das änderte natürlich auch die Anforderungen an die Verordnung. So wurde der Vorschlag an KI-Modelle mit allgemeinem Verwendungszweck angepasst und überarbeitet.

Dieser Aspekt der Verordnung war nicht unumstritten, denn genau in diesem Punkt hat man Innovationshemmnisse gesehen. Christiane Wendehorst weiß über die schwierigen Verhandlungspunkte und sagt, dass „einige Mitgliedstaaten plötzlich große Bedenken hatten, dass ihre eigenen Startups, sozusagen die Risingstars am KI-Markt, hier möglicherweise zu stark eingeschränkt würden“.

Diese Bedenken hätte man aber in den Verhandlungen lösen könnn. „Man hat bestimmte Dinge abgeschwächt, Kompromisse gefunden und vor allem muss man sagen: Am Ende hat dann der gemeinsame Wille überwogen, diese KI-Verordnung auf den Weg zu bringen“, resümiert die Rechtswissenschafterin.

Der EU AI Act will globale Standards setzen

“Unser KI-Gesetz wird auch einen erheblichen Beitrag zur Entwicklung globaler Leitplanken für vertrauenswürdige KI leisten”, kündigte Ursula von der Leyen den Anspruch der EU an, mit der KI-Verordnung globale Vorbildwirkung für sichere KI-Entwicklungen zu haben. Mit der KI-Verordnung ist Europa nicht nur die erste Region der Welt, die den Einsatz künstlicher Intelligenz umfassend reguliert, sie will damit auch weltweit Standards in der KI-Sicherheit setzen.

Dass das eine gute Entscheidung der Europäischen Union war und am Ende den Startups in der Region zu Gute kommt, davon ist Christiane Wendehorst überzeugt. Hätte sich die EU auf diese Verordnung nicht einige können, „wäre das ein enormer Gesichtsverlust für Europa gewesen“, sagt sie.

Sie sieht den unternehmerischen Vorteil in der KI-Verordnung darin: „Wenn die EU nicht reguliert hätte, hätten die Mitgliedstaaten im Prinzip regulieren können, wie sie das für richtig halten. Dann hätten wir einen Flickenteppich in der EU gehabt, wir hätten vielleicht einige Mitgliedstaaten gehabt, die ein sehr innovationsfeindliches Regime etabliert hätten und das wäre für die Unternehmen nicht gut gewesen. Unternehmen brauchen Planungssicherheit und deswegen wollten am Ende im Grunde alle diese KI-Verordnung haben.“, sagt die Professorin der Universität Wien im brutkasten-Talk.