✨ AI Kontextualisierung

Suggestion ist ein erprobtes Mittel, um Sachverhalte in einer bestimmten Weise darzustellen, die nicht ganz der Wahrheit entsprechen; aber schlussendlich auch nicht total unwahr sind. Man benutzt sie, um Gedanken, Ideen und Vorstellungen im Gegenüber einzupflanzen, ohne sich dabei wirklich angreifbar zu machen. Man suggeriert mit Worten, mit Zeilen und vor allem mit dem Dazwischen.

“Fake it, ’til you make it” indes ist eine seltsam anhaftende Weise, die aus den USA zu uns herübergetröpfelt ist und von allen Startup-Ökosystemen in allen Ländern scheinbar nicht nur geduldet wird, sondern als probates Mittel gilt. Was, der Sache auf den Kern gehend, ein Problem darstellt. Manchmal gebart sich die Startup-Szene wie ein “Beauty Contest”. Man schminkt sich, präsentiert sich und versucht vor allem eines: schön auszusehen.

In anderen Worten, man erstellt geschönigte Pitch-Decks, zahlt einen Haufen an Geld an PR-Agenturen, damit sie Aussendungen einen einzigartigen Spin verpassen und unauffällig übertreiben. Und manchmal tut man so als ob. Dies tut man um Investoren und Investor:innen zu beeindrucken, Kund:innen zu begeistern und öffentlich im guten Licht dazustehen.

Doch wo man oft Dinge nach außen trägt, dort werden diese auch kritisch beäugt – nicht nur als Due Dilligence, sondern auch unter dem Deckmantel der Verwunderung, wie viel Wahrheitsgehalt in Behauptungen steckt oder ob Übertreibung der Vater oder die Mutter des Dargestellten ist. So ähnlich geschehen bei Johannes Mansbart, einem der Gründer von Chatarmin.

Chatarmin-Founder als Provokateur

Mansbart ist mittlerweile vielen ein bekannter Name. Der Gründer des KI-Chatbot-Startups fällt vor allem auf LinkedIn durch seine provokanten Posts auf. Er propagiert lange Arbeitszeit als das Um und auf des Erfolgs, kritisiert New-Work-Tendenzen sowie individuelles Eingehen auf Mitarbeiter:innen-Bedürfnisse, berichtet regelmäßig von seiner Arbeitseinstellung, die ihn dorthin gebracht hat, wo er jetzt ist (zum Erfolg), erwähnt nebenbei seinen Reichtum in jungen Jahren, spricht von Wohlstandsverwahrlosung, attackiert die Konkurrenz und wettert gegen Menstruationstage, Frauenquoten und die 4-Tage-Woche. Er stellt sich aber auch kritischen Fragen und reagiert auf Kommentare – hier nachzulesen.

Vor kurzem stellte sein Startup Chatarmin einen selbst trainierbaren KI-Chatbot vor. Ein großer Meilenstein des WhatsApp-Software-Anbieters. Dadurch sollen Support- und Operations-Team entlastet werden. Mansbart kündigte dies auf LinkedIn wie folgt an:

“chatarmin.com goes AI! 🤖 Wir sind stolz, das erste Hashtag#whatsappmarketing Tool der Welt mit einer vollumfänglichen und DSGVO-konformen KI-Integration für unsere Kunden anzubieten. Was das bedeutet 🎬

- “Echter Support” statt “dummem Chatbot”

Wir können per Chatarmin WhatsApp KI nicht nur Webseiten, PDF’s und Notion-Wiki-Pages auswerten und damit unsere Kunden ihre eigenen WhatsApp KI Chatbots trainieren lassen.”

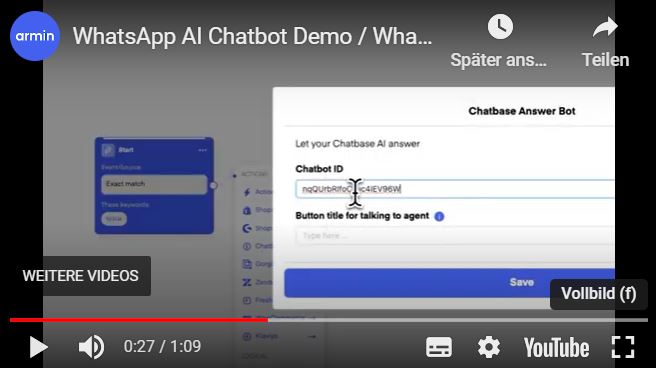

Zudem schrieb er per Aussendung: “Wiener WhatsApp-Marketing-Software launcht eigene WhatsApp KI für Unternehmen” und veröffentlichte ein Demo-Video, das die Funktionsweise erklärt.

Brutkasten wurde allerdings darauf aufmerksam gemacht, dass in jenem Video zwar gezeigt wird, wie man die neue WhatsApp-KI-Software nutzt, es sich aber um einen anderen Chatbot handelt, der dort verwendet wird, wie ab Sekunde 27 ersichtlich ist (siehe Screenshot).

Darin erkennt man, dass es sich um einen Chatbot-Builder von Chatbase handelt, der im Februar 23 von Yasser Elsaid entwickelt wurde. Dessen Firma sitzt in Toronto, Kanada.

An dieser Stelle stellt sich berechtigterweise die Frage, ob Chatarmin den AI-Bot, den es gelauncht hat, tatsächlich selbst gebaut oder ihn aus einer bestehenden Lösung entwickelt – also sich quasi draufgesetzt – hat. Und wieso man ein Chatbase-Demo-Video nutzt.

“In Ordnung Lösungen zusammenzustückeln, aber…”

Es sei zwar in Ordnung verschiedene Lösungen zusammenzustückeln, aber “nicht richtig und wahrhaftig” sie als eigene Lösung zu verkaufen, erklärt ein KI-Experte, der anonym bleiben möchte. “Kopieren ist eine Sache, aber man sollte nicht 1:1 kopieren, denn so kommt man in Teufels Küche. Wenn die Kopierten davon Wind bekommen, dann hat man andere Probleme. Und fair gegenüber Kunden ist es auch nicht. Irgendwann ist das Fass voll. Wenn du dich als ‘Nummer 1’ bezeichnest, dann musst du das validieren können.”

Das DSGVO-Problem: Das gilt es zu beachten

Doch es ist nicht nur die moralische Frage der Nachahmung, die an dieser Stelle als Kritik auftritt, sondern auch ein gänzlich anderes Problem, dem sich Gründerinnen und Gründer aus diesem KI-Bereich stellen und achtsam sein müssen: Datenschutz.

Es bleibt die Frage, ob bei “nicht eigens entwickelten” KI-Lösungen Daten von Kund:innen “ungefiltert” in ein Drittland wandern. Jeannette Gorzala, Rechtsanwältin in Wien mit Spezialisierung auf Wirtschaftsrecht und neue Technologien, erklärt in einem kurzen Exkurs allgemein die wichtigsten Punkte, die es bei dieser Thematik zu beachten gilt.

- Jedes Unternehmen ist grundsätzlich für die Einhaltung des Datenschutzes betreffend seinen Betrieb verantwortlich. Daher empfehle ich jedem Unternehmen zu prüfen, welche KI-Lösungen man implementiert und welche konkreten Konsequenzen sich daraus insbesondere für KI-Regulierung, Datenschutz, Urheberrechte und Haftungen ergeben.

- Für den Datenschutz konkret ist die Datenschutzerklärung ein guter erster Ansatzpunkt. Hier geht für Chatbase klar hervor, dass Daten in den USA verarbeitet werden und es wird auch eine Liste externer Sub-Auftragsverarbeiter zur Verfügung gestellt, in der zum Beispiel OpenAI und andere Anbieter angeführt werden. Kunden können sich daher nicht darauf berufen, nicht gewusst zu haben, dass Daten in den USA verarbeitet werden, wenn dies explizit in der Datenschutzerklärung offengelegt wird.

- Natürlich darf ein Anbieter zum Marketing nicht vorgeben oder fälschlicherweise behaupten, die gesamte Lösung inklusive des dahinterliegenden LLMs (Anm.: Large Lanuage Models) selbst entwickelt zu haben. Ein derartiges Verhalten kann Konsequenzen nach dem Gesetz gegen unlauteren Wettbewerb nach sich ziehen, beispielsweise wegen Irreführung über wesentliche Produktmerkmale.

- Nach der DSGVO kann eine internationale Übermittlung von Daten erfolgen, wenn ein angemessener Schutz der Grundrechte von natürlichen Personen mit Blick auf den Datenschutz gegeben ist. Die EU-Kommission hat festgelegt, dass in mehreren Ländern aufgrund ihrer Rechtsvorschriften oder internationaler Verpflichtungen ein angemessenes Datenschutzniveau gewährleistet ist. Zu diesen Ländern zählt unter anderem Kanada.

- Für die USA gibt es ein neues EU-US Data Privacy Framework (DPF), das den EU-US-Privacy-Shield ersetzt. Hier muss geprüft werden, ob das Unternehmen in den USA, an das Daten übermittelt werden, unter dem DPF zertifiziert ist. OpenAI ist zum Stichtag heute beispielsweise nicht gemäß dem DPF zertifiziert. Bei der Nutzung von Diensten von OpenAI (Anm.: ChatGPT) muss daher das Unternehmen, welches Dienste von OpenAI verwendet, selbst den Datentransfer prüfen und geeignete Maßnahmen zur Wahrung des Datenschutzes treffen. Wir empfehlen hier ein “Transfer Impact Assessment” und einen weiteren Maßnahmenkatalog zur Risikominimierung.

Chatarmin-Founder erklärt das Demo-Video

Um nach diesem Zwischenruf zurückzukehren: Auf die Frage, ob Chatarmin den Bot aus Kanada kopiert und eine eigene Version draufgesetzt hat bzw. warum man in der Demo Chatbase zeigt, erklärt Mansbart auf Nachfrage: “Für Demo-Zwecke ist es viel einfacher, Chatbase zu nützen – auch, weil wir nicht alles preisgeben können. Unsere Mitbewerber spionieren uns ständig aus. Darüber habe ich auch schon auf LinkedIn geschrieben. Unser LLM ist ebenso ChatGPT, die UI/UX ist für Kunden exakt dieselbe. Daher macht das total Sinn, für die Demo auf eine andere fertige Lösung zurückzugreifen.”

Zudem verweist der Founder auf einen Blogbeitrag vom 12. März 2024. Darin schreibt er: “Wir haben unseren hauseigenen ChatGPT WhatsApp-Chatbot mit unseren internen Ressourcen wie PDF-Dokumenten, Begriffsseiten und auch unserem Blog-Bereich hier auf chatarmin.com trainiert. Wir haben ausschließlich unsere hauseigene Software, Chatarmin, zusammen mit ChatGPT verwendet, um unseren ersten GDPR-konformen ChatGPT WhatsApp-Chatbot in Betrieb zu nehmen.”

OpenAI und GDPR

Cointelegraph schreibt in diesem Sinne jedoch zu OpenAI und dem Thema GDPR: “In der Datenschutzrichtlinie von OpenAI zu ChatGPT werden die Bemühungen des Unternehmens zur Einhaltung des kalifornischen Verbraucherschutzgesetzes erläutert. Allerdings sind die Angaben zu internationalen Gesetzen, einschließlich GDPR, recht dürftig. Die Datenschutzrichtlinie enthält allgemeine Informationen zur Verwendung personenbezogener Daten, zur Datenspeicherung und zum Zugriff durch Dritte.”

Der KI-Anbieter omnifact.ai berichtete zudem am 9. Februar 2024 wie folgt: “Die Einhaltung der GDPR ist ein Markenzeichen für verantwortungsvolle Geschäftspraktiken. Zum gegenwärtigen Zeitpunkt sind OpenAI und seine Plattform ChatGPT nicht in der Lage, die GDPR-Standards einzuhalten, aber sie arbeiten daran, die Komplexität der Einhaltung zu bewältigen.”

Ähnlich liest man das bei der International Association of Privacy Professionals vom 1. März 2024: “Die italienische Datenschutzbehörde ‘Garante’ hat nach einer Untersuchung festgestellt, dass der Chatbot ChatGPT von OpenAI gegen mehrere Bestimmungen der EU-Datenschutzgrundverordnung verstößt.” Und auch TechCrunch berichtete bereits Ende Jänner über ChatGPT und die GDPR-Problematik, hier nachzulesen.

Eine zweite Anfrage zu dieser Kritik an ChatGPT blieb bisher unbeantwortet. Jedoch geht Mansbart aus dem ersten Kontakt auf etwas anderes ein und stellt nach Kritik klar: “Wir haben nie behauptet, das erste WhatsApp-Marketing-Tool zu sein. Sondern: DSGVO-konform + KI. Und da sind wir weltweit die ersten. Das weltweit erste WhatsApp-Marketing-Tool mit DSGVO-konformer KI-Integration. Das ist Fakt. Es gibt dazu auch einen Blogpost (Anm.: vom 12. März 2024, dem gleichen Tag der Kontaktaufnahme des brutkasten mit Mansbart) von mir und wir haben erste Kunden auf unserer Solution live.”

“Ohne Imitation wäre der Mensch gar nicht überlebensfähig”

Zum Thema “Kopieren generell” meint der Founder, dass Kopieren in der menschlichen Geschichte seit der Ur-Existenz unserer Spezies seine Wurzeln hat: “Ohne Imitation wäre der Mensch gar nicht überlebensfähig. Im Business ist das so ein Thema, bei dem sich jeder ertappt, erwischt, aber auch verstanden fühlt. Jeder kopiert, jeder hat schon einmal kopiert, jeder wurde schon einmal kopiert. Daher ist das total müßig. Ein Startup mit P/M-Fit, bzw. ein funktionierendes Unternehmen, muss sich über Copycats niemals Gedanken machen und sollte wenn dann dankbar für Markt-Erweiterung und Challenge zur Produkt-Entwicklung sein. Denn Wettbewerb schafft Fortschritt.”

“99 Prozent von allem, was in Pitchdecks und Business-Plänen steht ist erlogen”

Auch zum Thema Suggestion bzw. “Fake it, ’til you make it” hat Mansbart klare Einstellungen: “Ich find es witzig, dass diese Frage von einem Startup-Medium kommt”, sagt er. “99 Prozent von allem, was in Pitchdecks und Business-Plänen steht, ist entweder erlogen oder zumindest massiv geschönt. Das ist das, was der Startup-Szene schadet. Und nicht, wenn ‘proven business models’ verbessert, iteriert, und auf neuen bzw. alternativen Märkten und mit iterierten Business-Models und bzw. oder Produkten weiterentwickelt werden. Man hat eine viel höhere Chance auf ‘Success’, wenn man sich Product/Market-Fit nicht von der Pieke auf selbst erarbeiten muss. Wir haben das getan, ich berichte auf LinkedIn täglich davon, und auch, wie hart das war.”

Und weiter: “Product/Market-Fit ist und bleibt ein Fremdwort für Österreichs Jungunternehmer-Szene, das führt zu einem langsamen und un-innovativen Ökosystem, wo leider prinzipiell nicht viel passiert. ‘Faken’ muss man eher anfangs etwas, wenn man noch keine Cases und Kunden hat. Denn Versuchskaninchen will keiner sein. Das hat auch unser Leben anfangs sehr erschwert. Der 17. Kunde ist viel leichter gewonnen als der dritte.”