Rund 80 Prozent aller Unternehmen testen ihre Anwendungen und Software händisch. Entweder klicken sie sich mühsam durch ihre Software oder ihren Webshop, um zu sehen, was funktioniert und was nicht, oder sie coden sich ihre Tests. Beides langwierige, kostenintensive und mühsame Aufgaben. Das wissen Leander Zaiser, CEO, Manuel Weichselbaum, CTO, und Markus Hauser, die gemeinsam mit Kevin Intering und Pascal Goldschmied das KI-Startup AnyConcept gegründet haben.

AnyConcept und das Problem der No-code-Software

Die Founder haben sich deswegen dazu entschlossen eine Testautomatisierungs-Software zu entwickeln, um den Prozess für Unternehmen zu vereinfachen und günstiger zu gestalten.

Zaiser war sechs Jahre lang RPA-Experte (Robotics Process Automation) bei Raiffeisen und hat dort Automatisierungssoftware automatisiert. Der CEO musste dabei feststellen, dass vermeintliche No-code-Software ohne Entwicklungskompetenzen sich nicht erfolgreich einsetzen ließ. Für gelernte Softwareentwickler wiederum war das Arbeiten mit solch einer Anwendung keine attraktive Tätigkeit.

Weichselbaum indes forscht seitdem er 17 ist an Künstlicher Intelligenz. Und widmet sich dabei vor allem immer den aktuellen Herausforderungen der internationalen Forschung. Das passte hervorragend zu Zaisers erkanntem Problem: aktuelle Automatisierungssoftware ist zu komplex für Non-Coder und nicht attraktiv genug für Coder. Also fragten sich die Founder: Was, wenn man Automatisierung mit einem No-Code-Ansatz macht, mithilfe einer KI, die genau das tut, was man ihr auf dem Bildschirm zeigt? So war AnyConcept geboren.

Das Black Friday-Problem

“Jede Software, jeder Webshop, jede Applikation muss immer wieder getestet werden, ob sie richtig funktioniert. Und da sie auch ständig durch neue Updates von Entwicklern oder bei einem Webshop mit neuen Produkten gefüttert wird, verändern sich Applikationen dauerhaft. Das kann wieder zum Brechen der bisherigen Funktionen führen”, erklärt Hauser, ein per Eigendefinition fleischgewordenes Startup-Kind, das zuletzt Johannes Braith (Storebox) als rechte Hand begleiten und somit Entrepreneurship aus nächster Nähe beobachten und Mitwirken durfte.

Der Gründer präzisiert sein Argument mit einem Beispiel passend zum Black Friday. Jedes Jahr würden Unternehmen Milliarden US-Dollar verlieren, weil sie ihre Preise falsch definieren oder Prozente und Dollar verwechseln, ohne dass es wem auffällt. Außerdem könnten “Trilliarden US-Dollar” an Schäden durch fehlerhafter Software, die nicht richtig getestet wurde, vermieden und “50 Prozent der IT-Projektkosten” gesenkt werden, wenn Testen automatisiert mit No-Code abläuft, so seine Überzeugung.

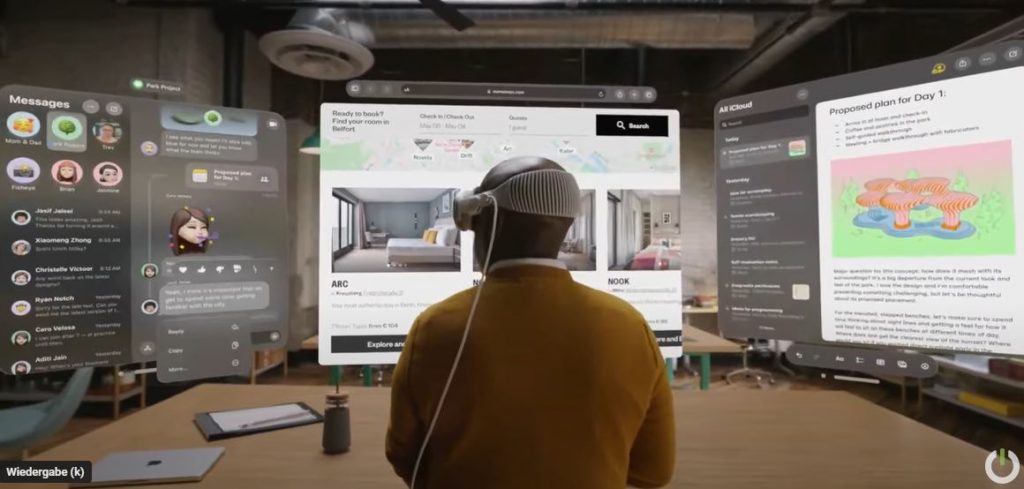

“Durch unser KI-Modell, das ein User-Interface rein durch Pixeldaten, Mausklicks und Tastatureingaben erkennen und manövrieren kann, schaffen wir es Automatisierung No-Code zu gestalten”, sagt Hauser. “Das Ziel ist es unsere KI-Agenten zukünftig zum Beispiel einen Prozess wie UI-Software-Testing rein durch eine Demonstration, das bedeutet das Vorzeigen des Testfalles, automatisiert durchführen zu lassen. Sie werden sich dabei exakt so verhalten wie es ein Benutzer tun würde, orientieren sich nur an den Elementen des User-Interface und konzentrieren sich nicht auf den dahinterliegenden Code. Das ist unser USP.”

FUSE for Machine Learning

Dieses Alleinstellungsmerkmal fiel auch Google auf. Konkreter Google Cloud Storage FUSE for Machine Learning. Anfänglich noch ein Open Source-Produkt als “Linux Filesystem in Userspace” oder eben als “FUSE” tituliert, wurde die Software von Google in die Cloud integriert und hilft beim Verwalten von Unmengen von Trainingsdaten, Modellen und Kontrollpunkten, die man zum Trainieren und Bereitstellen von KI-Workloads benötigt.

Anwendungen können hierbei direkt auf die Cloud zugreifen (Anm.: anstatt sie lokal herunterzuladen); als wären sie lokal gespeichert. Es müssten zudem keine benutzerdefinierte Logik implementiert werden und es gebe weniger Leerlaufzeit für wertvolle Ressourcen wie TPUs und GPUs, während die Daten übertragen werden.

FUSE sei einfach ein Produkt für Unternehmen, so Weichselbaum weiter, um große Datenmengen bequem zu verwalten und sie verfügbar zu machen: “Wir verwenden es, um viele Terrabytes von Daten auf der Cloud zu lagern, was am Computer nicht möglich ist”, sagt er.

Google sagt Hallo

Weil AnyConcept das Service von FUSE sehr intensiv nutzte, wurde Google auf die Grazer aufmerksam. Und hat konkret nachgefragt, was sie für einen Use-Case mit ihrem Angebot entwickelt haben. “Wir waren einer der ersten, die das genutzt haben, um effizient unsere KI-Agents zu trainieren“, sagt Weichselbaum. “Das Produkt von Google ist ein Teil unserer Datenverarbeitung und des Trainings unserer ganz spezifischen KI und Google wollte wissen, warum und wie wir das so intensiv verwenden. Das hat dazu geführt, dass wir unsere Ideen für Produktverbesserungen und Skripts mit ihnen teilen durften.“

AnyConcept und seine Konzepte

Das Ziel von AnyConcept ist es, ein Foundation-Modell nicht für Texte oder Bilder, sondern für Interaktionen mit dem User-Interface zu entwickeln.

Im Detail reicht hierbei eine Demonstration von einem solchen Interface und AnyConcept analysiert es mit neuronalen Netzwerken. Es erkennt Strukturen, die das Startup seinem Namen getreu “Konzepte” nennt und die auf breites Wissen aufbauen, wie man mit einem Computer interagiert.

“So ein Konzept wäre etwa ein ‘Button’ auf einer Website”, erklärt es Zaiser in anderen Worten. “Die KI versteht dann, dass man ihn anklicken kann und was danach passiert. Oder wie lange eine Website braucht, sich zu öffnen und wie sie aussieht.”

Aktuell forscht AnyConcept an der Generalisierungsfähigkeit ihres Netzwerkes. Zaiser dazu: “Wir testen unsere KI bereits mit Pilotkunden bei der Anwendung von Software-Testautomatisierung und bekommen großartiges Feedback.”