✨ AI Kontextualisierung

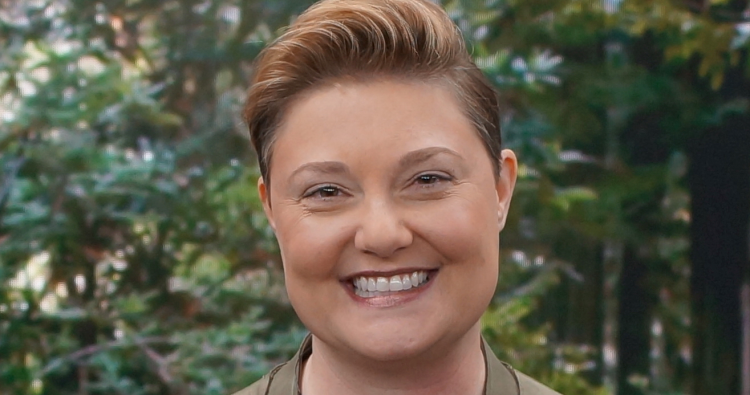

Kathy Baxter, Principal Architect, Ethical AI Practice bei Salesforce, stammt aus der Psychologie, brachte aber über 20 Jahre Erfahrung von großen Tech-Unternehmen mit zu Salesforce – unter anderem aus der UX (User Experience)-Forschung bei Silicon Valley Schwergewichten wie Oracle, Ebay, Google. Als Salesforce vor Jahren eine “AI-First”-Company wurde, startete Baxter mit der Entwicklung von Chatbots. Heute setzt sie sich intern vor allem für die Einhaltung “ethischer KI” ein – für diese Aufgabe wurde bei Salesforce sogar ein eigener, neuer Job in der Zentrale in San Francisco geschaffen.

Welches Potenzial bringt KI ins Marketing?

Baxter: Personalisierung ist wirklich das große Ding. Man will Empfehlungen erreichen, die dich ansprechen. Traditionell läuft das immer noch oft mit Demografie. Du bist eine Frau, also empfehlen wir Makeup. Männer sehen diese Anzeigen nicht. In den letzten Jahren haben wir aber gelernt, das Gender ein Spektrum hat. Jemand männliches kann sich ebenfalls für Makeup interessieren. Genauso gibt es Frauen, die keine Kleider mögen. Also müssen wir uns auf Interessen und Verhalten konzentrieren.

Viele Marken tun sich mit Personalisierung immer noch schwer. Ist ein Problem vielleicht, dass sich Kundenverhalten und die Umstände sich ständig und stark verändern?

Sich auf Demografie verlassen reicht einfach nicht mehr. Die Magie von KI ist, dass sie ständig lernt. Generation Z bringt eine neue Komplexität in das Gender-Thema, identifiziert sich aber stark damit. Die Pandemie hat das Kundenverhalten komplett auf den Kopf gestellt. KI kann damit umgehen und Probleme verhindert – zum Beispiel, dass Retailer ohne Ware oder mit viel zu viel Ware dastehen.

Mit dem Ende der Cookies kommen neue Fragen auf. Wie schaffen wir es Vertrauen aufzubauen? Wenn die Third-Party-Daten weg sind, kommt das, was wir “Zero-Party Daten” nennen. Wie können wir dich dazu bringen, dass du mir verrätst, was mich interessiert. Wir wollen dieses Vertrauen aufbauen, indem wir transparent sind. Der Kunde muss den Wert sehen, was er davon hat, wenn er diese Infos mit uns teilt – und wissen, was wir über ihn schon wissen. KI kann zudem Rückschlüsse ziehen wie “wenn dir dies gefällt, kannst du auch das gebrauchen”. Händler stehen vor Problemen wie Engpässe in der Lieferkette – hier können solche Empfehlungen eine riesige Hilfe bedeuten.

Aus dem Vertrauensverhältnis ergibt sich auch eine Verpflichtung für Brands abzuliefern, richtig?

Nicht nur daraus – auch aus Regulierungen. In Kalifornien gibt es zum Beispiel Vorgaben, wie Daten, die von Kindern stammen, verarbeitet werden dürfen. Es gibt Verpflichtungen für Transparenz, wie ein KI-Modell arbeitet – und warum es etwas empfiehlt. Selbst wenn sich eine Marke nicht so sehr um Vertrauen kümmert – die Privatsphäre-Vorgaben werden sie dazu zwingen.

Jeder Softwarehersteller bewirbt inzwischen seine eigene KI-Technologie. IBM mit Watson, Adobe mit Sensei. Was macht Salesforce mit seiner KI-Engine Einstein besser als die anderen?

Wir bieten “No-Code” und “Low-Code”-Lösungen für eine CRM-spezifische KI. Wir bieten auch eine General-Purpose-Entwicklungsumgebung, für KI-Anwendungen aller Art. Aber gebrauchsfertige Lösungen für Chatbots, die Sales und Kundenservice verstehen, die wissen wer der nächste Lead sein könnte oder die Verkaufsabbrüche verhindern können, sind sehr hilfreich, um Kundenbeziehungen an den Start und zum Laufen zu bekommen. In unserer Marketing Cloud haben wir einen Subject Line Generator, der verschiedene Tonalitäten versteht. Er kann FOMO [Anm.: Fear of Missing out] oder einen freundlichen Ton in der E-Mail Betreffzeile anschlagen.

Dennoch können die Kunden mit “Einstein Builder” unsere Technologien nutzen, um ihr eigenes KI-Modell auf dieser Basis zu entwickeln. Mit der Partnerschaft von AWS (Amazon Web Service) findet eine Demokratisierung von KI statt – nach dem Motto “Bring your AI”. So können Kunden die Daten aus einer Customer Data Plattform mit unserer Lösung zusammenbringen.

Ein Fokus der Salesforce-Keynote 2022 waren Echtzeit-Daten – ein großer Game-Changer in Sachen Personalisierung?

Daten sind oft statisch, fragmentiert, veraltet, ungenau – und dann auch noch schwer oder gar nicht zugänglich. Echtzeit mit unserer Lösung Genie ändert das komplett. Damit bekommen wir die alle und die genauesten Daten – die exakte Prognosen ermöglichen. Am Anfang von Covid sahen wir “schwarze Schwäne”. Die ganzen Datenmodelle brachen zusammen, weil sie nicht mehr funktionierten. Das zeigt, was Echtzeitdaten bewirken können – und wie wichtig Echtzeit wirklich ist.

Viele Unternehmen tun sich schwer dabei ihre Entscheidungen auf Basis von Daten, statt mit dem Bauchgefühl der jahrelangen Business-Erfahrung zu fällen. Was könnte helfen, Daten als Entscheidungshilfe mehr zu akzeptieren?

Wir wissen, wie wichtig Transparenz und Erklärungen sind. Das macht Einstein. Unsere Software zeigt, warum eine Empfehlung gegeben wird. Es ist so besser nachvollziehbar, warum ein bestimmter Kunde der nächste Lead sein wird. Das liefert Wertschöpfung im Geschäft, schafft Return on Investment und etabliert im Unternehmen Daten als Entscheidungshilfe.

Es gibt viele Horrorszenarien rund um KI. In Europa gibt es viele Skeptiker, etwa dass künstliche Intelligenz ein Jobkiller sein wird – oder gar die Weltherrschaft übernehmen wird. Kann Salesforce mit seinem “Ehtical AI”-Ansatz diese Ängste nehmen?

Das große Dilemma ist diese KI generierte Kunst, die gerade im Netz kursiert. Dall-e oder andere Bildgeneratoren erzeugen Bilder mit Copyrights, die sie sich selbst als System geben. Die künstliche Intelligenz wurde aber mit Bildern von echten Künstlern trainiert, die nichts für ihren Input bekommen. Das ist etwas, was wir als Gesellschaft oder Staat verhindern müssen. Wir sorgen mit unserem “Ethical AI”- Richtlinien dafür, dass Rechte – zum Beispiel das Grundrecht sich mit seiner Arbeit den Lebensunterhalt zu verdienen – respektiert und eingehalten werden.

Die Terminator-Szenarien, in denen die KI alles übernimmt und uns in Büroklammern verwandelt – diese sind Jahrzehnte weit weg in der Zukunft. Wir müssen uns aber auf die Schäden konzentrieren, die KI heute anrichten kann, wenn zum Beispiel Kunst kostenlos generiert wird und den Künstlern ihre Arbeit wegnimmt.

Schlimm ist auch wenn Gesichtserkennung falsche Vorhersagen macht und die Polizei deswegen die falschen Personen festnimmt. Oder wenn die KI unfairerweise bestimmten Personen den Zugang zu Jobs verhindert. Diese Dinge müssen heute angegangen werden. Aus diesem Grund ist zum Beispiel Gesichtserkennung in unserer KI mit ihren strengen Richtlinen nicht erlaubt.