✨ AI Kontextualisierung

Man klickt auf „Start Game“, dann wartet man kurz. Entweder startet das Gegenüber den Chat, oder man selbst wird dazu aufgefordert. Nun bleiben zwei Minuten Zeit für eine kurze Konversation. Am Ende muss man entscheiden: Mensch oder KI? Hat man mit einem anderen User oder mit einem Chatbot getippt? Die Antwort wird prompt geliefert. So funktioniert „Human or not?“ des israelischen KI-Scaleups AI21 Labs.

Großangelegtes Turing-Experiment

Das Spiel dient nicht nur zum Selbsttest oder zur Belustigung. Tatsächlich handelt es sich dabei um ein großangelegtes Turing-Experiment. Die „Spielregeln“ dafür wurden bereit in den 1950er-Jahren vom britischen Mathematiker Alan Turing definiert – damals rein hypothetisch: Wenn eine Maschine ihr menschliches Gegenüber davon überzeugen kann, dass sie ein Mensch ist, hat sie den „Turing-Test“ bestanden. [Anm: Der Wissenschaftler konzipierte damals ein Setting, in dem die Testperson blind mit zwei Gesprächspartner:innen konfrontiert wird, von denen nur eine:r ein Mensch ist.]

„Human or not?“-Chatbot täuscht Nutzer:innen in 40 Prozent der Konversationen

Und tatsächlich gelingt es der „Human or not?“-KI, die auf GPT-4 von OpenAI und dem hauseigenen Sprachmodell Jurassic-2 basiert, gar nicht so selten, Spieler:innen zu täuschen. Das Spiel ist seit Mitte April online und wurde seitdem laut des AI21 Labs von mehr als 1,5 Millionen Menschen ausprobiert, die insgesamt mehr als zehn Millionen Konversationen führten. Nun veröffentlichte das Unternehmen einen Zwischenbericht mit Statistiken.

Demnach lagen die „Human or not?“-User:innen in 68 Prozent der Fälle richtig mit ihrer Einschätzung. Während die Testpersonen allerdings ein menschliches Gegenüber in 73 Prozent der Konversationen korrekt identifizierten, schaffen sie das bei einem KI-Gesprächspartner nur in 60 Prozent der Fälle. Anders gesagt, die Künstliche Intelligenz schafft es in 40 Prozent der Chats, ihr Gegenüber erfolgreich zu täuschen und somit den abgewandelten Turing-Test zu bestehen.

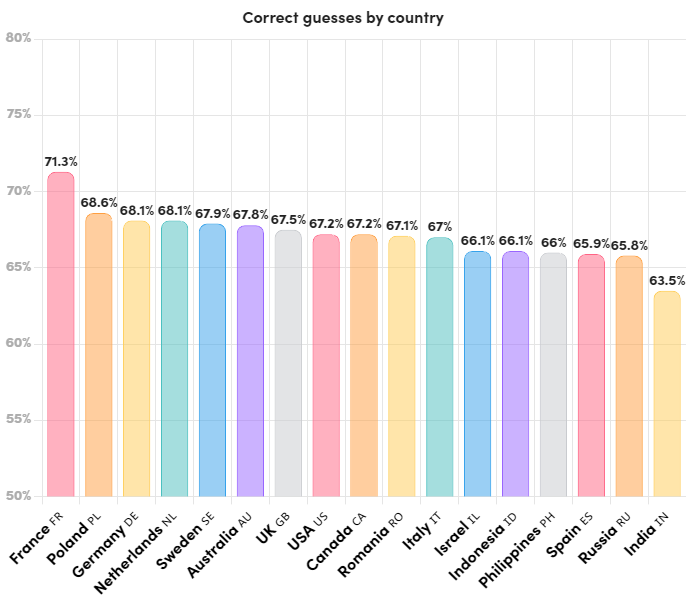

Franzos:innen liegen öfter richtig

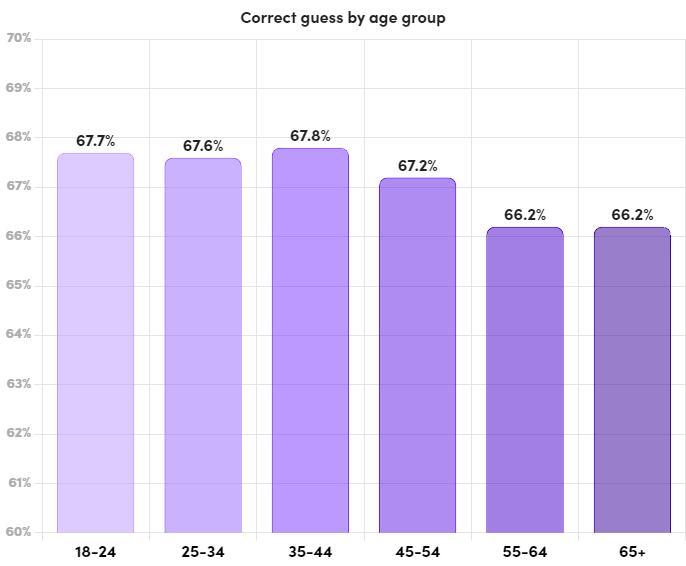

Während das Geschlecht der Proband:innen bei der Einschätzung kaum relevant ist (Frauen liegen 67,7, Männer in 67,4 Prozent der Fälle richtig), gibt es etwas größere Unterschiede zwischen den Herkunftsländern und den Altersgruppen der Testpersonen. Positiv stechen Spieler:innen aus Frankreich heraus mit 71,3 Prozent richtigen Einschätzungen, negativ Personen aus Indien mit nur 63,5 Prozent. Von den Altersgruppen liegen die 35- bis 44-Jährigen mit 67,8 Prozent am häufigsten richtig. Am häufigsten täuschen lassen sich die 55- bis 64-Jährigen sowie die über 65-Jährigen (jeweils 66,2 Prozent korrekte Einschätzungen).

Strategien, um der „Human or not?“-KI nicht auf den Leim zu gehen

AI21 Labs wertete auch die von Nutzer:innen eingegebenen Phrasen aus und leitete daraus typische Strategien ab, Mensch von KI zu unterscheiden. So würden Proband:innen etwa von der Annahme ausgehen, dass der Chatbot keine Rechtschreib- und Grammatik-Fehler macht und keine Slang-Ausdrücke nutzt. Tatsächlich wurde er aber auch darauf trainiert. User:innen versuchen es häufig mit persönlichen Fragen oder Fragen zu aktuellen Ereignissen – auch darauf kann die „Human or not?“-KI erstaunlich gut antworten. Gar nicht wenige Spieler:innen schließlich geben sich selbst als KI-Chatbot aus – was ihnen laut dem Startup tendenziell nicht so gut gelingt.