✨ AI Kontextualisierung

Wenn Artificial Intelligence (AI) in die falschen Hände gerät, könnte es passieren, dass der Mensch Sklave seiner eigenen Erfindung wird. Und sogar von ihr ausgelöscht wird. Stephen Hawking, der international renommierte Astro-Physiker und Cambridge-Professor hat zuletzt auf der “Zeitgeist 2015″-Konferenz genau davor gewarnt. Nun warnt er aktuell vor einem neuen Szenario: Den Einsatz von künstlicher Intelligenz bei Waffen.

Hawking fürchtet, dass intelligente Computer den Menschen überholen und ihn quasi zum persönlichen Spielzeug machen könnten. Und das schon in sehr naher Zukunft. “Computer mit künstlicher Intelligenz werden Menschen in den nächsten 100 Jahren überholen. Wenn das passiert, müssen wir sicher stellen, dass die Ziele der Computer mit den unsrigen einhergehen”, so Hawking gegenüber dem Magazin TechWorld.

Bereits Anfang diesen Jahres hat Hawking zusammen mit prominenten Namen wie Tesla-Gründer Elon Musk einen offenen Brief unterschrieben, indem vor einer unkontrollierten Entwicklung künstlicher Intelligenz gewarnt wird. “Unsere Zukunft ist ein Rennen zwischen wachsender Möglichkeiten im Bereich Technologie und der Weisheit, mit der wir sie nutzen”, so Hawking. Er sei in Sorge, befürchte er immerhin, dass die Sorge, wer Artificial Intelligence kontrolliert, jener weichen wird, ob man sie überhaupt kontrollieren kann.

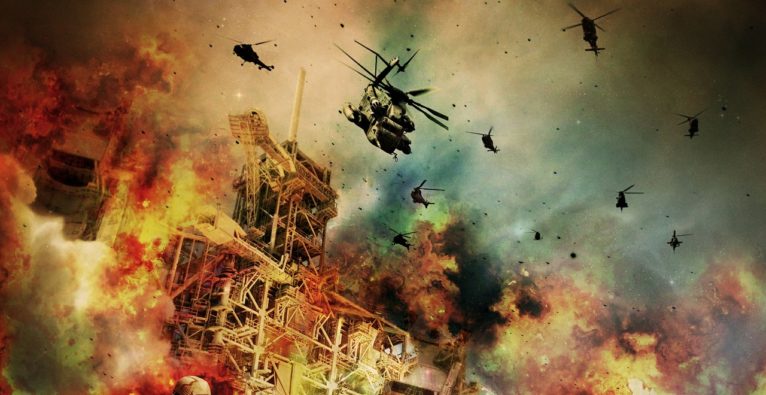

Das Future of Life Institute, das die Risiken von Artificial Intelligence für die Menschen untersucht, hat nun einen Brief veröffentlicht, der von über 1.000 Wissenschaftlern für Robotik und Künstlicher Intelligenz unterzeichnet wurde – inklusive Elan Musk, Stephen Hawking und Apple-Co-Founder Steve Wozniak. Darin wird vorm Einsatz von AI bei Waffen gewarnt. So seien autonome Waffen nach Schießpulver und nuklearen Waffen die dritte Revolution im Waffenwesen: „Die Kalaschnikows von morgen“

Anders als bei Nuklearwaffen, die sehr teuer sind, kosten autonome Waffensysteme vergleichsweise sehr viel weniger. Man müsse aufpassen, dass AI dazu verwendet wird, den Menschen zu schützen und nicht, ihn zu töten.

Der Brief schließt mit dem Satz: „Wir glauben daran, dass AI großes Potential hat, der Menschheit in vielen Bereichen zu helfen, und oberstes Ziel sollte es sein, genau dies zu tun“

P.S. Stephen Hawking beantwortet aktuell Fragen via Reddit – und jeder kann mitmachen.

Feedback? Contact & Follow me on twitter: @derbrutkasten, @die_theresa